La société OpenAI a mis au point des modèles d’intelligence artificielle permettant de générer des images à partir d’une phrase.

OpenAI, la société d’intelligence artificielle, a présenté le 5 janvier deux nouveaux systèmes très innovants, le DALL-E et le CLIP. Le DALL-E tire son nom de la contraction du nom de l’artiste espagnol surréaliste Salvador Dali et du robot de Pixar WALL-E. Ce modèle d’IA a pour mission de générer une image à partir d’un texte. CLIP est quant à lui un modèle qui est capable d’apprendre à reconnaître des catégories d’objets très rapidement.

Comment ça fonctionne ?

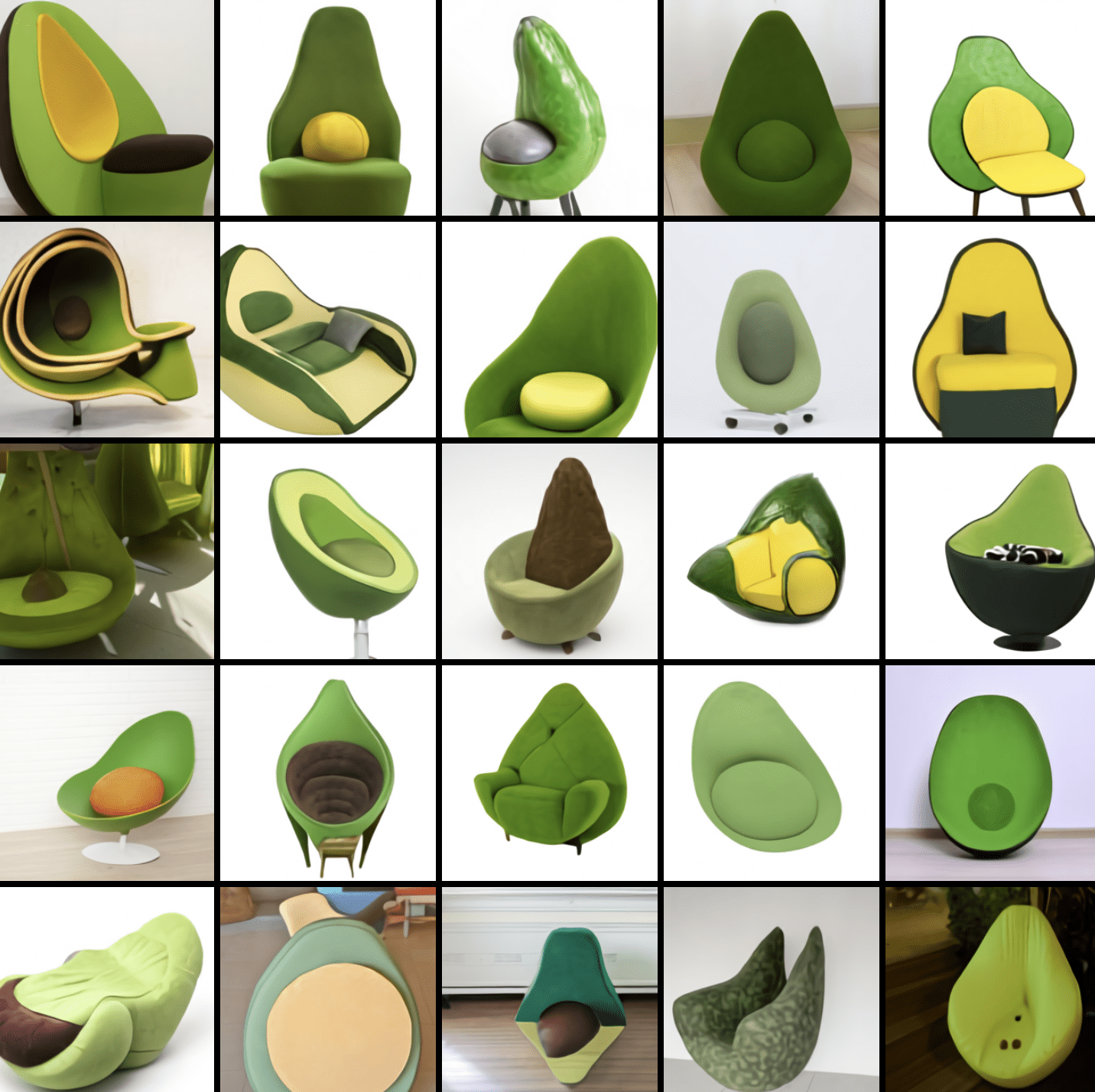

DALL-E peut générer une image y compris à partir de concepts qu’il n’aurait pas rencontrés pendant son entraînement. Il s’appuie sur GPT-3, un modèle de langage développé par OpenAI, 12 millions de paramètres entrent en compte. A partir de quelques mots clés entrés dans un corpus, DALL-E génère plusieurs images où apparaissent les différents éléments demandés, par exemple un bébé radis en tutu promenant son chien. DALL-E a la capacité de manipuler et de réorganiser des objets dans des images générées.

CLIP est un réseau neuronal qui peut prendre n’importe quel ensemble de catégories visuelles et créer en instantané des descriptions textuelles très fiables et visuellement classifiables. Même si ce sont des innovations importantes, ces nouveaux modèles sont loin d’être parfaits. Pour DALL-E, le problème reste que le résultat dépend encore beaucoup de la façon dont le corpus de texte est formulé, les images ne sont pas toujours cohérentes.

Pour le moment, OpenAI n’a pas d’idée réelle de ce à quoi pourrait servir DALL-E. Mais la société promet d’organiser prochainement une conférence pour détailler les objectifs et les applications.

Leave a Reply

You must be logged in to post a comment.